MIT’ın Bilgisayar Bilimleri ve Yapay Zeka Laboratuvarı’ndaki (CSAIL) araştırmacılar, objeleri gördüğünde hissedebilen bir robot geliştirdi. Yeni yapay zeka, sadece bakarak objelerin nasıl hissettirebileceğini kavrayabilecek. Robot, bu özelliğin yanı sıra dokunarak objenin nasıl görüneceğini de tasvir edebilecek.

CSAIL’de doktora öğrencisi ve sistem hakkındaki araştırmanın başyazarı olan Yunzhu Li, projenin robotların gerçek dünyadaki objeleri denetim etmelerini kolaylaştıracağını bildirdi ve şu açıklamada bulundu:

“Modelimiz, sırf bakarak düz bir yerin ya da keskin bir objenin nasıl hissettireceğini hayal edebiliyor. Görsel data almadan etrafı dokunarak keşfettiğindeyse modelimiz etrafını kestirim edebiliyor. Bu iki duyuyu bir ortaya getirdiğimizde robotları güçlendirip objeleri kavramak ve manipüle etmek için gereken bilgiyi azaltabiliriz.”

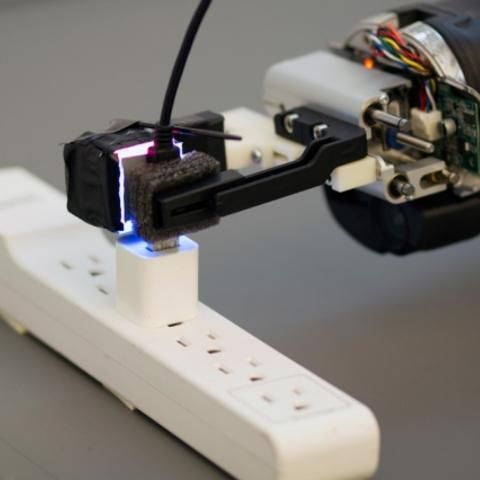

Araştırma grubu, modeli eğitmek için içerisinde dokunma duyusuna sahip sensörler bulunan, GelSight isimli bir KUKA robot kolunu kullandı. Bu eğitimin akabinde model 200 adet objeye 12.000 defa dokunarak görsel ve dokunsal dataları kaydetti. Bu bilgilere dayanarak 3 milyon görsel dokunsal imge oluşturuldu ve bu imgelere VisGel ismi verildi.

Aşağıdaki görüntüde 48’inci saniyeden itibaren GelSight teknolojisinin kullanıldığı ve kullanılmadığı testi mukayeseli bir halde izleyebilirsiniz.